Is the LLM winter coming?

In der KI-Welt häufen sich Meldungen über Verzögerungen und Probleme. Die großen Namen der Branche – Amazon, Meta, OpenAI, Apple – verschieben ihre ambitionierten Projekte. Ist das der Anfang vom Ende des KI-Booms? Ein genauerer Blick lohnt sich. Amazons ambitionierte Pläne für ein generatives KI-Upgrade von Alexa wurden wiederholt verschoben. Der Grund? Zuverlässigkeitsprobleme – selbst […]

AI potential: can we release the handbrake?

Ein großer Teil der Unternehmen hat in den letzten Jahren mit KI-Techniken wie Large Language Models (LLMs) experimentiert, und die ersten Ergebnisse und Anwendungen sind da (siehe Quellen). Doch oft bleiben sie halbherzig. Es scheint als hätten die Firmen Angst, das volle Potenzial der KI auszuschöpfen. Warum ist das so, und wie können wir die […]

OpenAI verschiebt den Launch ihres AI-Agenten „Operator“ wegen Sicherheitsbedenken

OpenAI hat seine AI-Agenten-Lösung „Operator“ noch nicht freigegeben, obwohl Anthropic und Microsoft bereits entsprechende Funktionalitäten am Markt haben. Der Grund dafür ist die Verwundbarkeit der Agenten gegenüber sog. Prompt Injections, wie das Magazin „The Information“ berichtete. So kann es bei einem Agenten, der selbstständig Informationen im Internet sucht, beispielsweise dazu kommen, dass er sich auf […]

ChatGPT Search wird manipuliert

Eine der Hauptanwendungen von Large Language Models (LLMs) ist die Erschließung von Dokumenten, besonders verbreitet dabei die Suche nach Information im Web. Jetzt hat mit dem Guardian erstmals ein General-Interest-Medium prominent auf ein grundsätzliches Problem der LLMs in diesem Zusammenhang hingewiesen – sie sind sehr leicht zu manipulieren, u.a. durch die Texte, die sie für uns […]

LINK2AI beim GenAI-Tag der PwC Deutschland

PricewaterhouseCoopers Deutschland, eines der führenden Beratungsunternehmen im Bereich Generative KI ist überzeugt, dass KI vor allem vertrauenswürdig sein muss. Darum haben PwC Deutschland und LINK2AI eine Partnerschaft geschlossen. Sichere KI ist auch eines der Fokusthemen beim GenAI-Tag, den PwC für Partner, Kunden und Interessierte veranstaltet. An der Panel-Diskussion zum Thema „Entwicklung von Vertrauenswürdigen KI-Systemen“ wird […]

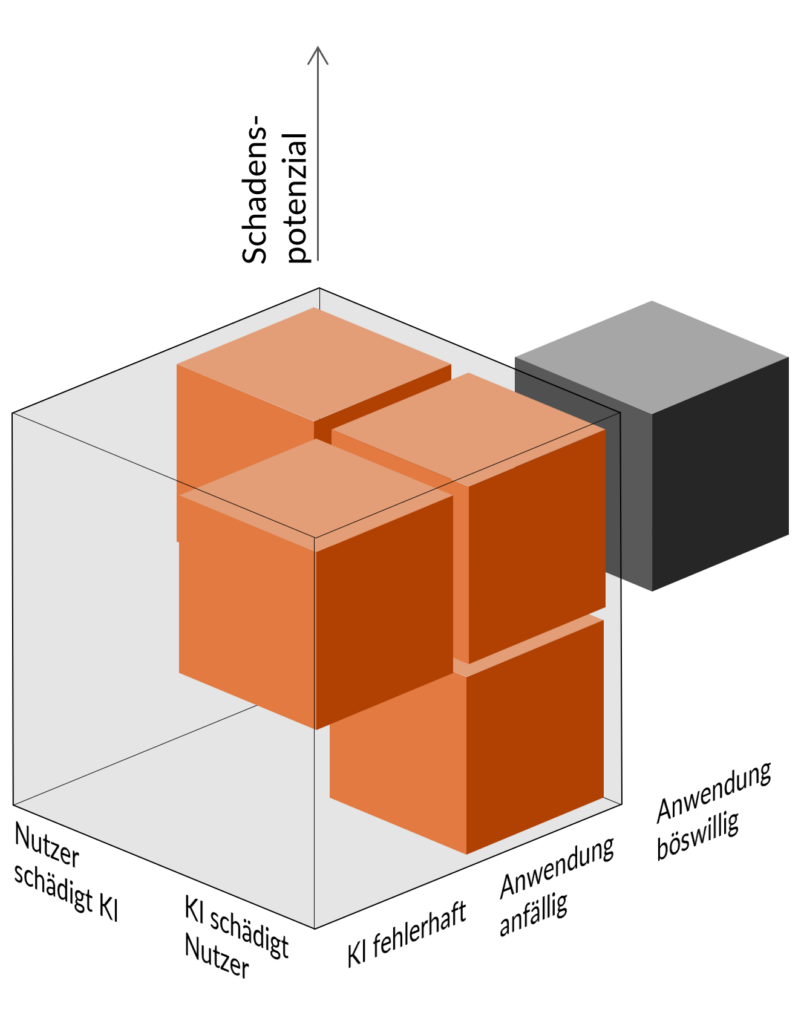

Der EU AI Act – wen soll er schützen und vor wem?

Der EU AI Act – wen soll er schützen und vor wem? Die aktuelle KI-Landschaft bietet enorme Möglichkeiten, es gibt aber auch zahlreiche Risiken, und auch mit denen müssen wir uns auseinandersetzen. Hier kann ein rechtlicher Rahmen wie der EU AI Act durchaus hilfreich sein. Risikopotenzial gibt es in vielen Bereichen: Nicht alle diese Risiken […]

Das Risiko-Team kündigt bei OpenAI

Das Risiko-Team kündigt bei OpenAI OpenAI prioritising ’shiny products‘ over safety, says departing researcher (computing.co.uk) Jan Leike, einer der führenden Köpfe des Sicherheitsteams macht nach seiner Kündigung bei OpenAI auf Twitter/X öffentlich, dass sein Team in den vergangenen Monaten “heftigen Gegenwind” vom Management der Firma erhalten hatte. Er ist der Meinung, dass viel mehr Kapazität […]

Hub Night

Hub Night Die Hub Night im Fraunhofer SIT war ein tolles Event für unser Team von LINK2AI! Vielen Dank an Carlina Bennison und das ganze STARTUPSECURE-Team! Fesselnde Vorträge, wichtige Kontakte – und richtig Spaß hat es auch noch gemacht! Wir hatten an unserem Stand im Foyer des SIT in Darmstadt große Resonanz: superspannende Gespräche mit […]